Чи може YouTube заспокоїти своїх теоретиків змови?

У новому дослідженні розглядаються зусилля YouTube щодо обмеження поширення теорій змови на своєму сайті, починаючи з відео, в яких стверджується, що кінцеві часи наближаються до тих, що ставлять під сумнів кліматичні зміни.

У новому дослідженні розглядаються зусилля YouTube щодо обмеження поширення теорій змови на своєму сайті, починаючи з відео, в яких стверджується, що кінцеві часи наближаються до тих, що ставлять під сумнів кліматичні зміни.

Продюсери Рамсі Тейлор, Алана Челі та Дейв Хорн

Зміна клімату - це обман, Біблія передбачала обрання президента Трампа, а Ілон Маск - шанувальник диявола, який намагається опанувати світ.

Усі ці вигадки знайшли життя на YouTube, найбільшому в світі відеосайті, зокрема тому, що власні рекомендації YouTube спрямовували людей на їхній шлях.

Протягом багатьох років це був високоефективний мегафон для теоретиків змов, і YouTube, який належить і управляється Google, визнав це. У січні 2019 року YouTube заявив, що обмежить поширення відеороликів, "які можуть дезінформувати користувачів шкідливими способами".

Через рік YouTube рекомендує теорії змови набагато менше, ніж раніше. Але його прогрес був нерівномірним, і він продовжує вдосконалювати певні типи вигадок, згідно з новим дослідженням дослідників з Каліфорнійського університету, Берклі.

Зусилля YouTube щодо стримування теорій змови є важливим випробуванням здатності Кремнієвої долини боротися з дезінформацією, особливо напередодні виборів цього року. Дослідження, яке вивчало вісім мільйонів рекомендацій протягом 15 місяців, дає одне з найбільш чітких уявлень про цей бій, і неоднозначні результати показують, наскільки проблематичним залишається питання для таких компаній, як Google, Facebook і Twitter.

Дослідники виявили, що YouTube майже вичерпав деякі теорії змови зі своїх рекомендацій, включаючи твердження про те, що земля рівна і що уряд США здійснив теракти 11 вересня - дві неправди, які компанія визнала цілями минулого року. У червні YouTube заявив, що кількість часу, який люди витрачають на перегляд таких відео за його рекомендаціями, зменшилася на 50 відсотків.

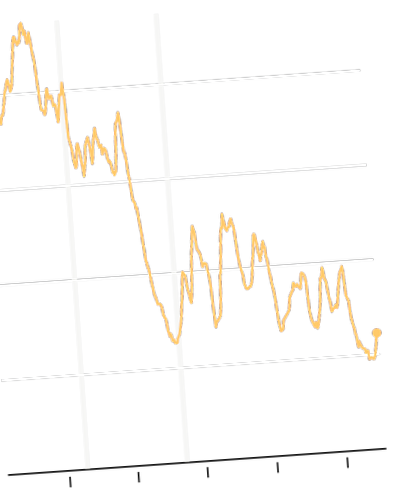

Проте дослідники Берклі виявили, що відразу після того, як YouTube оголосив про успіх, його рекомендації щодо теорій змови знову підскочили, а потім коливалися протягом наступних кількох місяців.

Це частка змовних відео, рекомендованих із найпопулярніших кліпів, пов’язаних з новинами

Дані також показали, що інші рекомендації YouTube продовжували процвітати, наприклад, твердження про те, що іноземці створили піраміди, що уряд приховує секретні технології і що зміна клімату - брехня.

Дослідники стверджують, що ці висновки свідчать про те, що YouTube вирішив, які типи дезінформації він хоче викорінити і які типи він готовий дозволити. "Це технологічна проблема, але насправді це також проблема політики", - сказала Хані Фарід, професор інформатики в Каліфорнійському університеті в Берклі та співавтор дослідження.

"Якщо у вас є можливість по суті керувати деяким особливо проблематичним вмістом близьким до нуля, тоді ви можете зробити більше для багатьох речей", - додав він. "Вони використовують слово" не можу ", коли вони означають" не буде "."

Представник YouTube Фаршад Шадлу, сказав, що рекомендації компанії спрямовані на те, щоб спрямувати людей на авторитетні відео, які залишають їх задоволеними. За його словами, компанія постійно вдосконалює алгоритм, який формує рекомендації. "Лише за минулий рік ми запровадили понад 30 різних змін, щоб зменшити рекомендації щодо прикордонного змісту та шкідливої дезінформації, включаючи дезінформацію щодо кліматичних змін та інші види конспіративних відео", - сказав він. "Завдяки цій зміні, час перегляду цього вмісту, який отримують рекомендації, зменшився в США на понад 70 відсотків"

Потужний алгоритм рекомендацій YouTube, який штовхає своїх двох мільярдів користувачів щомісяця до відеороликів, які, на їх думку, вони будуть переглядати, стимулював сходження платформи до нового телевізора для багатьох людей у всьому світі. Компанія заявляє, що її рекомендації спрямовують понад 70 відсотків із понад одного мільярда годин, які люди витрачають на перегляд відео щодня, роблячи програмне забезпечення, яке вибирає рекомендації, серед найвпливовіших алгоритмів у світі.

Успіх YouTube прийшов із темної сторони. Дослідження показали, що в рекомендаціях сайту систематично посилюються розділювальні, сенсаційні та явно неправдиві відео. Інші алгоритми, призначені для привернення уваги людей, щоб показати їм більше реклами, наприклад стрічка новин Facebook, мали таку ж проблему.

Ставки високі. YouTube стикається з натиском дезінформації та недоброзичливого вмісту, що завантажується щодня. F.B.I. нещодавно визначив поширення теорій конспірації як внутрішню загрозу терору.

Минулого місяця німець поклав на YouTube стяжку, сказавши, що «невидимі таємні товариства» використовують контроль над розумом, щоб знущатись над дітьми в підземних бункерах. Пізніше він вистрілив і вбив дев'ять людей у передмісті Франкфурта.

Для вивчення YouTube пан Фарід та інший дослідник Берклі Марк Фаддул об’єдналися з Гійомом Шасло, колишнім інженером Google, який допоміг розробити механізм рекомендацій і зараз вивчає його.

З жовтня 2018 року дослідники зібрали рекомендації, які з’явилися поряд із відео з понад 1000 найпопулярніших та рекомендованих каналів, пов’язаних з новинами YouTube, що робить їх дослідження одним із найдовших та найглибших досліджень цієї теми. Потім вони навчили алгоритму, щоб оцінити за шкалою від 0 до 1 ймовірність того, що певне відео розповсюджує теорію змови, включаючи аналіз її коментарів, стенограми та опису.

- Вогонь поширюється на північ, загрожуючи яблуневими садами - The New York Times

- Змова (2001) - Гнилі помідори

- Теорія змови - клуб Фрімлі Гріна

- Кардіо-теніс для набору ендорфінів і схуднення - The New York Times

- Теорії змови поширюються так само швидко, як коронавірус